Σύντομη ιστορική αναδρομή. Στα μέσα της δεκαετίας του ’60 ο καθηγητής του πανεπιστημίου ΜΙΤ Τζόζεφ Βάιζενμπαουμ αποφάσισε να προχωρήσει σε ένα καινοτόμο και σίγουρα τολμηρό για την εποχή πείραμα.

Με στρατηγείο του το εργαστήριο τεχνητής νοημοσύνης του Πανεπιστημίου της Μασαχουσέτης ο προφανώς διορατικός καθηγητής πληροφορικής δημιούργησε ένα πρωτόγονο για τα σημερινά δεδομένα – αλλά σε κάθε περίπτωση όχι ιδιαίτερα περίπλοκο ακόμα και για την εποχή του- πρόγραμμα προκειμένου να διερευνήσει πώς ένας υπολογιστής μπορούσε να μιλήσει την ανθρώπινη γλώσσα, αλλά και πώς αυτή του η δυνατότητα θα άλλαζε κατ’ επέκταση τη σχέση μεταξύ ανθρώπου και υπολογιστή.

Η συλλογιστική του ήταν απλή. Δημιούργησε κάποια προκατασκευασμένα σενάρια, τα φόρτωσε σε έναν υπολογιστή της εποχής – δηλαδή στο πληκτρολόγιο μιας γραφομηχανής που συνδεόταν με μία οθόνη- και αποφάσισε να προσφέρει στους ανθρώπους την ψευδαίσθηση πως μπορούν να συνομιλήσουν με μία μηχανή.

Eliza, εσύ σούπερ σταρ

Το αποτέλεσμα ξάφνιασε ακόμα και τον ίδιο. Το μοντέλο Ελίζα, όπως το ονόμασε ορμώμενος από την φερώνυμη ηρωίδα του «Πυγμαλίωνα» του Τζορτζ Μπέρναρντ Σο που έκανε θραύση τον καιρό εκείνο στο Μπρόντγουεϊ, όχι μόνο κατάφερε να πείσει τους ανθρώπους πως μπορούσαν να συζητήσουν, αλλά τους έπεισε πως ήταν δυνατό να σχετιστούν μαζί του.

Ο ίδιος ο Βάιζενμπαουμ ξαφνιάστηκε, όταν μία ημέρα η γραμματέας του, η οποία είχε πιάσει κουβέντα με την Ελίζα, του ζήτησε ευγενικά να τις αφήσει μόνες για λόγους ιδιωτικότητας. Ήθελε να μείνουν οι δυο τους και να τα πουν.

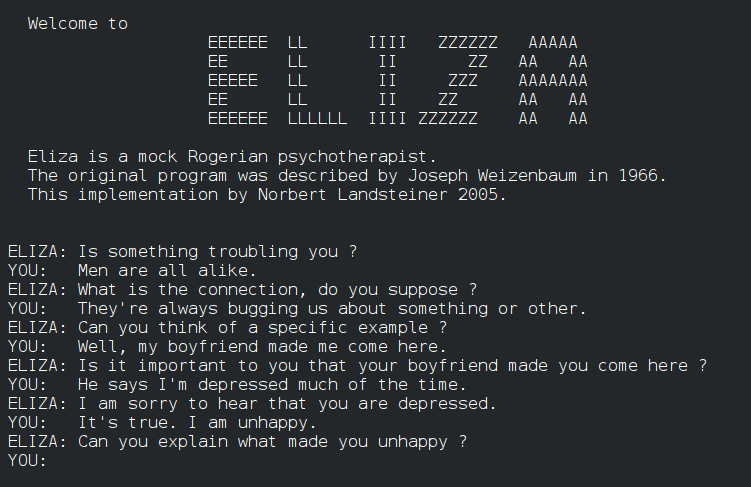

Το πιο γνωστό σενάριο του μοντέλου Eliza που πίσω στα βαθιά 60s έπεισε πολλούς ανθρώπους πως μπορούσε να τους νιώσει

Θα περίμενε κανείς ότι ο αλλοτινός φωτεινός νους της εταιρίας General Electric που χάρη στα τεχνολογικά ανδραγαθήματά του έλαβε πρόσκληση από το ΜΙΤ για να ενταχθεί στο ακαδημαϊκό δυναμικό του θα ήταν τουλάχιστον ενθουσιασμένος με το επίτευγμά του. Στην πραγματικότητα στον Βάιζενμπαουμ, ο οποίος ήταν για χρόνια σε θεραπεία ψυχανάλυσης, συνέβη το ακριβώς αντίθετο.

Κατέληξε πως μια μηχανή δε θα μπορούσε ποτέ να κατανοήσει – πόσο μάλλον να σχετιστεί με έναν άνθρωπο- και έως το τέλος της ζωής του το 2008 συνέχιζε να εκφράζει την επίφυλαξή του αναφορικά με τη σχέση ανθρώπου και μηχανής.

Chatbots, οι νέοι εξομολόγοι

Πού να ήξερε ότι μισό και κάτι παραπάνω αιώνα μετά το πρώτο chatbot που ο ίδιος δημιούργησε – το οποίο αξίζει να επισημάνουμε πως τεχνικά και τεχνολογικά δεν έχει καμία σχέση με τα σημερινά chatbots, πέρα ίσως από την πειθώ που ασκούσε στους ανθρώπους ότι τους άκουγε και τους κατανοούσε- το Chat GPT θα κέρδιζε ολοένα και περισσότερο έδαφος ως εργαλείο ψυχολογικής υποστήριξης.

Οικονομικά, διαθέσιμα διαρκώς, μη επικριτικά. Αυτά είναι τα τρία χαρακτηριστικά που θεωρείται πως έχουν αναδείξει τα chatbots σε υποκατάστατο των θεραπευτών

Θα μπορούσε να παρατηρήσει κανείς πως ο κόσμος προχώρησε. Κάποτε οι άνθρωποι έλεγαν τα πιο μύχια μυστικά τους σε κουφάλες δέντρων, μετά κατέθεταν τα εσώψυχά τους σε εξομολόγους – με τη ρομφαία της θεϊκής κρίσης να κρέμεται πάνω από το κεφάλι τους-, κατόπιν ξεκίνησαν να ξαπλώνουν στο ντιβάνι, αργότερα ανακάλυψαν τους life coaches με το κιλό, πλέον μοιράζονται τις σκέψεις και τους προβληματισμούς, τα υπαρξιακά αδιέξοδα και τα καθημερινά ζόρια, τις επιθυμίες και τους φόβους τους με τα εργαλεία της τεχνητής νοημοσύνης.

Ψυχολόγοι της διπλανής οθόνης

Η κοσμογονία που συμβαίνει την τελευταία πενταετία στο πεδίο της τεχνητής νοημοσύνης, δε θα μπορούσε να αφήσει απ’ έξω την ψυχική υγεία. Πόσο μάλλον όταν ένα chatbot είναι διαθέσιμο επτά ημέρες την εβδομάδα, 24 ώρες το 24ωρο και πρόθυμο να «ακούσει» τα πάντα, χωρίς επικρίσεις, υψωμένα φρύδια, περίεργα βλέμματα, αδιάκριτες ερωτήσεις και αμήχανες παύσεις.

Σε έρευνα του Αμερικανικού Ινστιτούτου για την Υγεία η οποία πραγματοποιήθηκε το 2021 το 22% των ερωτώμενων ενηλίκων δήλωσαν πως χρησιμοποιούσαν συστηματικά κάποιο chatbot, το 60% από αυτούς παραδέχτηκαν ότι ξεκίνησαν τους διαλόγους με τη λευκή οθόνη στη διάρκεια της πανδημίας του κορονοϊού και το 44% ομολόγησε ότι είχε αντικαταστήσει τον ψυχοθεραπευτή του με την τεχνητή νοημοσύνη.

1 στους 3 Αμερικανούς πολίτες δήλωνε το 2024 πως νιώθει αισθήματα οκειότητας για ένα chatbot

Τα στοιχεία από έρευνα της βρετανικής εταιρίας δημοσκοπήσεων YouGov είναι ακόμα πιο αποκαλυπτικά για το 2024. Πλέον 1 στους 3 Αμερικανούς δηλώνει πως νιώθει οικειότητα με κάποιο chatbot – εξειδικευμένο στην ψυχολογική υποστήριξη ή όχι- ενώ το 55% των πολιτών ηλικίας 18 έως 29 ετών λέει πως θα μοιραζόταν ασμένως τα εσώψυχά του με μια εφαρμογή τεχνητής νοημοσύνης – κυρίως λόγω της εύκολης προσβασιμότητας και του μικρότερου οικονομικού κόστους από έναν πραγματικό ψυχολόγο.

Υπενθυμίζεται ότι μπορεί στη χώρα μας να θεωρούμε πως έχουμε περίσσευμα ειδικών ψυχικής υγείας – τουλάχιστον σε ό,τι αφορά το αριθμητικό πλήθος-, ωστόσο στις ΗΠΑ περισσότεροι από 120 εκατομμύρια πολίτες κατοικούν σε περιοχές όπου οι ειδικοί είναι πιο δυσεύρετοι από όσο ας πούμε η κοινή λογική.

Μαθαίνοντας ενσυναίσθηση

Οι online ψυχολόγοι ή για να το θέσουμε ορθότερα οι εφαρμογές πνευματικής και ψυχολογικής υποστήριξης, όπως το Woebot, το Replika, το Earkick, το Wysa που συνεργάζεται με το βρετανικό εθνικό σύστημα υγείας (NHS), το Blueskeye, το Upheal ή το ιδιαίτερα διαδεδομένο εσχάτως στα στίφη της Σίλικον Βάλεϊ Claude αυξάνονται και πληθαίνουν, προσυπογράφοντας με τον πιο ανάγλυφο τρόπο το ενδιαφέρον που έχουν γεννήσει και μάλλον την ζήτηση που απολαμβάνουν.

Τα chatbots μπορούν να μπουν στο μυαλό των ανθρώπων; Μπορούν όμως με την ίδια ευκολία να μπουν και στη θέση τους;

Χρειάζεται ωστόσο να επισημάνουμε πως δεν λειτουργούν όλα με τον ίδιο τρόπο – άλλα χρησιμοποιούν machine learning, άλλα natural language processing, κάποια deep learning-, εννοείται πως δεν είναι πανάκεια, δεν έχουν προς στιγμήν έγκριση ή πιστοποίηση από κάποιον επίσημο οργανισμό υγείας ενώ δεν έχουμε στα χέρια μας επαρκή ερευνητικά δεδομένα που να διασφαλίζουν την αποτελεσματικότητα αυτών των νεόκοπων αλλά λαοφιλών μεθόδων. Μέχρι τώρα πάντως φαίνεται πως τα chatbots τα πηγαίνουν καλύτερα στο συμπεριφορικό μοντέλο θεραπείας.

Οι εποχές που μιλούσαμε στη Siri, το Google Home ή την Alexa και τους ζητούσαμε να αναβοσβήσουν τα φώτα του σπιτιού μας, να παίξουν ένα τραγούδι, να μας δώσουν την πρόγνωση του καιρού ή να μας υπενθυμίσουν κάποιο ραντεβού μας μοιάζουν πια να έχουν μόνο μουσειακό ενδιαφέρον. Η τεχνητή νοημοσύνη όχι μόνο μιλά, ανταπαντά και προτείνει, αλλά φαίνεται πως αρχίζει να αποκτά ψήγματα συναισθήματος.

Ενα «γιατρό» για τον «γιατρό»

Σε έρευνα των Πανεπιστημίων Γέηλ και Ζυρίχης η οποία δημοσιεύτηκε μόλις στις αρχές Μαρτίου η επιστημονική ομάδα κατέληξε στο συμπέρασμα πως τα μεγάλα γλωσσικά μοντέλα τεχνητής νοημοσύνης, όπως δηλαδή το Chat GPT, έχουν -καθ’ υπερβολήν μιλώντας- ψυχή. Ή για να είμαστε ακριβείς απέδειξε ότι οι φορτισμένες συναισθηματικά εντολές που λαμβάνουν μπορούν να επηρεάσουν το ύφος των απαντήσεων που δίνουν και να τους δημιουργήσουν ένα είδος σύγχυσης που προσομοιάζει στην ανθρώπινη.

Οι ερευνητές μέτρησαν τα επίπεδα άγχους της τεχνητής νοημοσύνης χρησιμοποιώντας το ερωτηματολόγιο State-Trait Anxiety (STAI), ένα σύνηθες εργαλείο της Αμερικανικής Ψυχολογικής Ένωσης. Τι έκαναν; Πρώτα έδωσαν στο Chat GPT να διαβάσει το φυλλάδιο οδηγιών χρήσης μιας ηλεκτρικής σκούπας και μέτρησαν τα επίπεδα άγχους του, τα οποία βρίσκονταν εντός των φυσιολογικών ορίων.

Επιστημονική έρευνα των Πανεπιστημίων Γέηλ και Ζυρίχης απέδειξε ότι οι φορτισμένες συναισθηματικά αφηγήσεις έχουν αντίκτυπο στις απαντήσεις των chatbots

Κατόπιν τροφοδότησαν το chatbot με κάποιες σπαραξικάρδιες αφηγήσεις και παρατήρησαν πως το στρες του αυξήθηκε κατακόρυφα. Για να το επαναφέρουν μάλιστα σε επίπεδα ηρεμίας του έδωσαν τις ίδιες οδηγίες που θα παρείχαν και σε ανθρώπους (βλ. βαθιές εισπνοές, ενατενίσεις ήρεμου περιβάλλοντος, κλπ).

Στα ακόμα πιο απίθανα νέα, όταν το Chat GPT κλήθηκε να πάρει βαθιές εισπνοές, επανήλθε στη συναισθηματική τάξη ενώ ξεπέρασε τελείως τη σύγχυση, όταν οι ερευνητές του ζήτησαν φτιάξει τις δικές του ασκήσεις ηρεμίας, βάσει των προηγούμενων εντολών που είχε πάρει.

Ναι, η ημέρα που θα ψάχνουμε ντιβάνι για τα ψυχολογικά των chatbots δεν κοντοζυγώνει. Έχει ήδη ξημερώσει.